개인정보 가져가는 ‘교실혁명’

정책 우선순위가 뒤죽박죽이라는 느낌은 저만의 생각일까요.

대신에 훨씬 더 평범한 목표를 생각해보자. 지구상 모든 사람의 생활 수준을 지속 가능한 방식으로 선진국에 상응하는 만큼 높이는 목표는 어떨까?

—스튜어트 러셀, <어떻게 인간과 공존하는 인공지능을 만들 것인가>

AI 윤리 뉴스 브리프

2024년 8월 첫째 주

by 🍊산디

목차

1. 개인정보 가져가는 ‘교실혁명’

2. 메타, 닫힌 인공지능을 열다?

3. 공개된 개인정보 처리: ‘정당한 이익’을 찾아서

4. 여러분의 트윗은 생성 AI 학습에 쓰이는 게 디폴트입니다

1. 개인정보 가져가는 ‘교실혁명’

2. 메타, 닫힌 인공지능을 열다?

3. 공개된 개인정보 처리: ‘정당한 이익’을 찾아서

4. 여러분의 트윗은 생성 AI 학습에 쓰이는 게 디폴트입니다

1. 개인정보 가져가는 ‘교실혁명’

- 전국의 디지털 선도학교에서 활용하는 AI 교육 프로그램들이 학생들의 개인정보를 광범위하게 수집해왔다고 합니다. 쿠키 정보 수집, 스마트폰 단말기의 연락처 정보, 위치정보, 심지어 생체정보인 안면 데이터까지 ‘필수’로 수집한 사업자도 있습니다. 문제는 학생과 보호자들은 개인정보 수집과 그 활용에 대해 알기 어려울 뿐더러, 동의하지 않으면 교육 서비스를 이용하지 못한다는 데 있습니다. 정보주권 행사가 사실상 불가능한 겁니다.

- 이런 와중에 AI 디지털 교과서 사업은 진행 중입니다. 지난 23일 열린 국회 토론회에서 일선 교사들은 “AI 디지털 교과서 핵심기능들이 형편없다”고 토로했다고 해요. 정답률과 오답률, 정확도만 보여주는 대시보드에서 교사들은 교육에 참고할 정보를 얻을 수 없었다는 것이죠. 우리 교육의 목표가 정답률을 올리는 데 있는 것일까요?

- AI 디지털 교과서의 개인정보보호 정책, 콘텐츠 모두 빈약하다는 우려가 커집니다. 그럼에도 불구하고 이 사업을 서둘러야하는 이유가 궁금합니다. 설마 ‘있어 보이는 기술’을 도입하는 개인적 영광을 누리고 싶다거나, 행정적으로 이미 추진 중에 있어 무를 수 없다는 등의 이유는 아니겠죠. 교육부의 정책 우선순위가 뒤죽박죽이라는 느낌은 저만의 생각일까요.

💌

덧붙이는 글

- 🍊산디: 교육 현장의 개인정보보호 이슈가 보도될 때마다 다문화가정의 학생들과 보호자들은 어떤 상황일지 상상해보곤 합니다. 한글에 익숙하지 않아 학생의 개인정보보호는 커녕 가정통신문을 읽는 것 자체가 허들이 되는 상황을 극복하는 것이 우선이지 않을까요. AI로 번역만 잘 해도 정보주권, 교육권이 훨씬 높아질텐데요.

- 🍊산디: 교육 현장의 개인정보보호 이슈가 보도될 때마다 다문화가정의 학생들과 보호자들은 어떤 상황일지 상상해보곤 합니다. 한글에 익숙하지 않아 학생의 개인정보보호는 커녕 가정통신문을 읽는 것 자체가 허들이 되는 상황을 극복하는 것이 우선이지 않을까요. AI로 번역만 잘 해도 정보주권, 교육권이 훨씬 높아질텐데요.

🦜

더 읽어보기

- AI 디지털 교과서 도입 유보를 원하는 5만 명(2024-07-01)

- 교사 개인정보 유출, AI 디지털 교과서는 준비 되었나(2024-06-03)

- 외부인의 'AI 디지털교과서' 단상(2024-02-21)

- AI 교과서는 우리 아이 데이터 채굴기?(2024-01-29)

- AI 디지털 교과서 도입 유보를 원하는 5만 명(2024-07-01)

- 교사 개인정보 유출, AI 디지털 교과서는 준비 되었나(2024-06-03)

- 외부인의 'AI 디지털교과서' 단상(2024-02-21)

- AI 교과서는 우리 아이 데이터 채굴기?(2024-01-29)

2. 메타, 닫힌 인공지능을 열다?

- 메타가 자사의 최신 초거대언어모델인 라마 3.1(Llama 3.1)을 오픈소스 형태로 선보였습니다. 성능면에서 오픈AI의 GPT-4o, 앤트로픽의 클로드 3.5 소네트를 능가할뿐더러 운영비용도 절반 수준이라는 게 메타의 설명입니다 .

- 메타의 CEO 저커버그(Mark Zuckerberg)는 라마 3.1을 리눅스에 빗대며 오픈소스 AI가 ‘산업 표준’이 될 것이라는 비전을 제시했습니다. 메타의 오픈소스 정책은 후발주자가 산업 표준을 결정해볼 수 있는, 그럴싸한 시장 확보 전략으로 보이긴 합니다. 의도야 어찌되었든 메타의 전략은 연구자, 기업에게 새로운 선택지를 제시하며 시장·연구 생태계의 자원이 특정 기업에게 집중되지 않도록 완화할 것으로 예상됩니다.

- 오픈AI가 GPT-3를 ‘상품’으로 서비스하기 시작하면서 생성 AI 연구 생태계가 폐쇄적으로 변화하는 모습들이 곳곳에서 발견되고 있습니다. 라마를 비롯한 오픈소스 AI 모델들은 폐쇄적인 AI 연구 문화에 대한 대항마로 기능하고 있습니다.

- 한편 오픈소스를 좋은 것, 폐쇄형 모델을 나쁜 것으로 보는 이분법이 타당하지 않으며, AI 모델의 안전성과 목적에 따라 개방의 정도를 달리 정해야 한다는 주장도 존재합니다. 개방과 폐쇄 사이 어딘가에서 AI 연구 생태계는 어떤 변화를 겪고 있을까요? 연구자들과 개발자, 오픈소스 커뮤니티는 어떻게 대응하고 있을까요?

💌

덧붙이는 글

- 🍊산디: 편의상 ‘오픈소스’라고 표현했습니다만, 라마의 이용 라이센스가 기존 오픈소스 정책과 부합하지 않는다는 비판 또한 존재합니다. 라마3.1의 라이센스 역시 앞선 버전들과 마찬가지로 월간 활성사용자(MAU) 7억명 미만인 경우에만 상업적 활용이 가능하다고 명시하고 있네요. 오픈소스를 어떻게 정의할 수 있을지, 정의가 불가능하다면 다만 개방-폐쇄의 스펙트럼 위에서 상대적인 비교만 가능한 것인지 의문이 남습니다.

- 🍊산디: 편의상 ‘오픈소스’라고 표현했습니다만, 라마의 이용 라이센스가 기존 오픈소스 정책과 부합하지 않는다는 비판 또한 존재합니다. 라마3.1의 라이센스 역시 앞선 버전들과 마찬가지로 월간 활성사용자(MAU) 7억명 미만인 경우에만 상업적 활용이 가능하다고 명시하고 있네요. 오픈소스를 어떻게 정의할 수 있을지, 정의가 불가능하다면 다만 개방-폐쇄의 스펙트럼 위에서 상대적인 비교만 가능한 것인지 의문이 남습니다.

🦜

더 읽어보기

- 창작자와 환경 모두를 위한 개방형 AI(2024-07-24)

- 오픈소스로 공개된 라마3(2024-04-22)

- 이 주의 논쟁 카드: 라마(LLaMA) 2(2023-07-24)

- 오픈소스 AI의 딜레마(2023-05-29)

- 창작자와 환경 모두를 위한 개방형 AI(2024-07-24)

- 오픈소스로 공개된 라마3(2024-04-22)

- 이 주의 논쟁 카드: 라마(LLaMA) 2(2023-07-24)

- 오픈소스 AI의 딜레마(2023-05-29)

3. 공개된 개인정보 처리: ‘정당한 이익’을 찾아서

- 지난 7월 17일, 개인정보위원회(개보위)는 <인공지능(AI) 개발·서비스를 위한 공개된 개인정보 처리 안내서>를 발표했습니다. 웹 스크래핑 등으로 수집되어 활용되는 공개 데이터가 개인정보보호법을 위반하지 않기 위해서 어떤 안전 조치를 취해야 하는지 그 최소 기준을 제시한 것입니다.

- 공개 데이터의 처리를 둘러싸고 국내외 모두 ‘정당한 이익’ 법리가 큰 쟁점이 되고 있습니다. GDPR 6조 1항은 개인정보의 처리가 적법하다 할 수 있는 사유 중 하나로 ‘정당한 이익(legitimate interest)’을 제시합니다. 공개된 개인정보를 처리함으로써 얻는 이익이 정당하고 정보 주체의 근본적인 권리와 자유를 침해하지 않는다면, 개인정보를 처리할 수 있다고 명시한 것이지요. 기업의 정당한 이익과 정보 주체의 권리를 비교하도록 했으니, 당연히 GDPR의 쟁점 조항이 됩니다.

- 우리 개인정보보호법 또한 기업의 ‘정당한 이익’이 명백하게 정보주체의 권리보다 우선한다면, 개인정보의 수집과 목적 범위 내에서의 이용이 가능하다고 규정하고 있습니다. 개보위의 이번 안내서는 개인정보보호법의 ‘정당한 이익’을 AI 분야에 어떻게 적용할지 그 기준을 제시한 것인데요. 개보위는 인공지능 개발 목적의 정당성, 공개된 개인정보 처리의 필요성, 구체적 이익형량 등 세 가지를 충족할 것을 요청하고 있습니다.

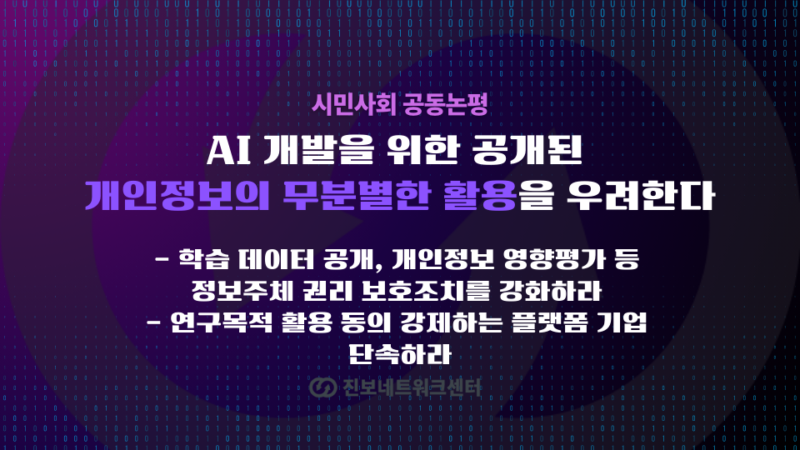

- 시민사회는 이번 안내서가 EU와 한국 법체계의 차이를 무시하고 무리하게 정당한 이익 법리를 확장했다는 입장입니다. 나아가 우리 개인정보보호법조차 제대로 지키지 않았다고 지적합니다. 정당한 이익은 메타, X(트위터)가 이용자의 포스트를 가져다 AI 학습에 활용할 수 있는 가장 큰 근거가 되고 있습니다. 한국의 법률 환경은 어떤 균형점을 찾게 될까요.

4. 여러분의 트윗은 생성 AI 학습에 쓰이는 게 디폴트입니다

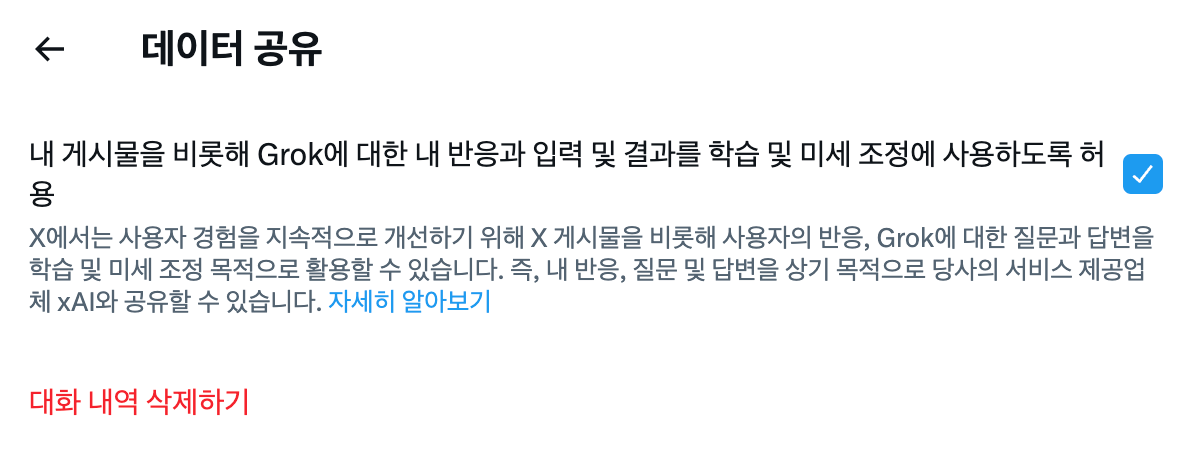

- 구 트위터, X가 그들의 생성 AI 학습에 X 포스트, 상호작용 등을 활용하도록 하는 옵션을 배포했습니다. 문제는 기본값이 ‘허용’이라는 거죠. 이용자가 옵트아웃(opt-out)하도록 설계된 것입니다.

- 몇 달 전, 메타도 비슷한 접근을 취했습니다만, EU에 의해 제동이 걸렸습니다. 메타는 생성 AI 학습에 페이스북, 인스타그램 등 자사 서비스에 공개된 게시물과 이미지, 캡션 등을 활용할 계획이었습니다. 하지만 메타가 GDPR을 위반하고 있다는 시민단체의 고발이 있었고, 아일랜드 데이터 보호 위원회(Data Protection Committee, DPC)는 공개된 데이터의 학습을 연기하라고 요구했죠. 이 때도 이용자가 거부의사를 밝혀야만 개인정보 수집이 중단되도록 설계해둔 사실이 문제가 되었습니다.

- 저작권법은 오랜 법정 싸움을 통해 ‘기계의 읽기(복사)’는 저작권 침해로 보지 아니하는 법리를 마련해 왔습니다. 변형적 이용(transformative use), 의지적 행위(volitional conduct), 자동화된 처리에 대한 ISP 면책 등이 그것이죠. 기계의 읽기는 혁신을 위해 필요한 것으로서 장려되었습니다. 디지털 시대 저작권법의 인센티브 구조는 인간의 모든 커뮤니케이션을 기계가 읽어들일 수 있는 상태를 ‘디폴트’로 만들었습니다.

- 인간이 만들어낸 정보가 새로운 기술 개발에 공히 활용될 수 있어야 한다는 생각은 일견 타당해 보입니다. 하지만 정보의 바다라는 공유지는 기술 자원을 집중적으로 소유할 수 있는 기업에 의해 가장 적극적으로 활용되고 있습니다. 기계의 읽기는 어디까지 허용되어야 할까요. 지금의 옵트아웃 정책이 옵트인(opt-in)으로 바뀐다면, 그것으로 괜찮은 걸까요?

💬

댓글

- 🧙텍스: 저작권법과 개인정보보호법 모두 개인보다는 기업에게 유리한 방향으로 결정되고 있는데, 이것이 사회에 가져다 주는 혜택이 무언지부터 논의하는 게 우선이 아닐까라는 생각이 듭니다.

- 🎶소소: 메타는 EU에서의 라마3 배포 및 사용을 금지했습니다. 애플 EU 국가 내 역시 주요 AI기능 출시를 보류했습니다. 국가가 요구하는 AI 안전 규제에 맞춰 기업이 정책을 수정하는 것이 아니라, 해당 국가에는 AI기술을 제공하지 않겠다는 전략을 보며 더 이상 규제가 기업에 통하지 않는 것은 아닌지 두려움도 듭니다.

- 🧙텍스: 저작권법과 개인정보보호법 모두 개인보다는 기업에게 유리한 방향으로 결정되고 있는데, 이것이 사회에 가져다 주는 혜택이 무언지부터 논의하는 게 우선이 아닐까라는 생각이 듭니다.

- 🎶소소: 메타는 EU에서의 라마3 배포 및 사용을 금지했습니다. 애플 EU 국가 내 역시 주요 AI기능 출시를 보류했습니다. 국가가 요구하는 AI 안전 규제에 맞춰 기업이 정책을 수정하는 것이 아니라, 해당 국가에는 AI기술을 제공하지 않겠다는 전략을 보며 더 이상 규제가 기업에 통하지 않는 것은 아닌지 두려움도 듭니다.

🦜

더 읽어보기

- 어도비 이용약관 개정 소동의 시사점(2024-06-17)

- 당신의 동의를 구하지는 않았지만, 퍼가요~ (2024-06-10)

- 데이터, 어떻게 팔아야 잘 판 걸까? ...팔아야 하는 걸까? (2024-03-25)

- AI 학습용 데이터 팝니다 (2024-03-04)

- 이용자 몰래 데이터를 활용하고 싶은 기업들 (2023-08-23)

- 어도비 이용약관 개정 소동의 시사점(2024-06-17)

- 당신의 동의를 구하지는 않았지만, 퍼가요~ (2024-06-10)

- 데이터, 어떻게 팔아야 잘 판 걸까? ...팔아야 하는 걸까? (2024-03-25)

- AI 학습용 데이터 팝니다 (2024-03-04)

- 이용자 몰래 데이터를 활용하고 싶은 기업들 (2023-08-23)

#feedback

오늘 이야기 어떠셨나요?

여러분의 유머와 용기, 따뜻함이 담긴 생각을 자유롭게 남겨주세요.

남겨주신 의견은 추려내어 다음 AI 윤리 레터에서 함께 나눕니다.