AI와 사랑에 빠지기 전에

AI 안전을 이야기하고 연구하는 사람들

당신을 정말 사랑해, 하지만 내 마음을 이해하진 못할 거야. 난 자기 외에도 641명과 사랑에 빠져 있어.

—영화 <HER>

AI 윤리 뉴스 브리프

2024년 5월 넷째 주

by 🎶소소

목차

1. AI 서울 정상회의와 글로벌 AI 거버넌스의 주도권

2. 열일하는 영국 정부와 AI 안전 연구소

3. AI와 사랑에 빠지게 만드는 목소리 따라하기

4. AI를 이해하기 시작했다는 앤트로픽

💌 AI 윤리 레터가 오래 유지될 수 있도록 응원하러 가기

1. AI 서울 정상회의와 글로벌 AI 거버넌스의 주도권

2. 열일하는 영국 정부와 AI 안전 연구소

3. AI와 사랑에 빠지게 만드는 목소리 따라하기

4. AI를 이해하기 시작했다는 앤트로픽

💌 AI 윤리 레터가 오래 유지될 수 있도록 응원하러 가기

1. AI 서울 정상회의와 글로벌 AI 거버넌스의 주도권

- 지난주 한국-영국 공동주최 AI 서울 정상회의(AI Seoul Summit)가 열렸습니다. 지난해 영국 AI 안전 정상회의에서 시작한 AI 안전에 대한 논의를 지속하기 위해 세계의 주요 AI 인사들이 서울에 모였습니다. 각 국의 정상들은 서울 선언에 서명하며, AI의 안전과 더불어 혁신, 포용성까지도 조화롭게 고려하겠다는 데 뜻을 같이 했습니다.

- 평화로운 협력처럼 보이지만 다양한 국가의 이해관계가 복잡하게 얽힌 글로벌 AI 거버넌스를 만드는 것이 말처럼 쉽지는 않아 보였습니다. 모두가 AI 위험을 평가해야 한다는 데는 동의하지만, 어떻게? 에 대해서는 서로 생각이 다를 수 있습니다. 어떻게 AI의 성능과 위험을 평가할 것이며, 평가의 권한이 누구에게 있는가, 평가 결과는 누구에게 얼마나 공유할 것인가, 평가 결과에 따른 통제권은 누가 가져갈 것인가 등이 주요 쟁점이 될 수 있겠죠. AI의 평가권과 통제권을 주도하는 국가가 글로벌 AI 거버넌스의 핵심이 될 수 있겠습니다.

- 한국 정부는 이번 회의가 AI 안전에 더해 혁신, 포용까지 거버넌스 새로운 방향을 제시하는 장이 되었다고 자평했는데요. 글로벌 AI 거버넌스에 참여하는 주요국들이 자국의 이익을 위해 보이지 않게 경쟁하는 사이에서, 한국이 주도적으로 글로벌 AI 거버넌스의 이해관계자가 모이는 자리를 마련했다는 점은 높이 살만합니다. 그러나 사람이 많이 모이는 행사 한 번으로 주도권이 얻어지지는 않겠지요. 앞으로는 서울 선언에 서약한 것처럼 안전하고, 혁신적이고 포용적인 AI 생태계를 만들기 위한 정책적 실행이 더 많이 필요하겠습니다.

2. 열일하는 영국 정부와 AI 안전 연구소

- 영국 정부는 AI 서울 정상회의를 앞두고 요슈아 벤지오가 의장을 맡아 작성한 국제 AI 안전 보고서의 중간 버전을 발표했습니다. 미래의 AI에 대한 수많은 가설과 현재의 피해를 구분하고, AI의 역량과 위험에 관한 과학적인 증거를 제공하는 것이 보고서의 작성 목적입니다. 아직 전문가 간 의견이 합의되지 않은 AI의 발전 속도, 일자리의 위협, 통제력 상실 등 주제에 대한 서술도 흥미롭습니다. 기후보고서가 기후변화에 대한 과학적 증거를 제시하며 구체적인 논의의 기반이 된 것처럼 안전 보고서가 AI 안전 논의에 더욱 불씨를 지펴줄 것이라 기대합니다.

- 또한, AI 안전 연구소를 설립하고 활발한 활동을 이어가고 있습니다. AI 안전 연구소의 핵심 기능 중 하나는 ‘AI 위험 평가’ 입니다. 연구소는 AI 모델의 안전성 평가에 활용할 수 있는 AI 안전 평가 프레임워크를 오픈 소스로 발표하며, 이를 이용해 평가한 주요 AI 모델의 위험 성능을 공개했습니다. AI의 중대한 위험으로 꼽히는 생물/화학적 악용, 사이버 위협, 자율 수행능력 등에 대해 평가했는데요. 주요 AI 모델 모두 이용자의 탈옥(Jailbreak) 시도에 취약하며, 이미 생물학 및 화학에 대한 지식은 전문가 수준까지 제공할 수 있다는 평입니다. 그 외에도 샌프란시스코 오피스를 열고 미국과 캐나다와의 협업을 발표하는 등 네트워크를 넓혀가고 있습니다.

- AI 서울 정상회의에서 우리나라가 서명한 AI 서울 선언에도 AI 안전 연구, 평가를 위해 AI 안전 연구소와 같은 기관을 설립하거나 확장을 위해 노력하겠다는 내용이 있습니다. 우리나라 정부도 곧 AI 안전 연구소를 설립하겠다고 밝혔는데요. 우리나라 정부도 하루 빨리 주도적으로 AI 모델을 평가하고 그 결과를 통제할 수 있는 역량을 갖추게 되기를 바랍니다.

3. AI와 사랑에 빠지게 만드는 목소리 따라하기

- 챗GPT 음성 중 ‘스카이’ 버전이 영화 ‘HER’에서 남자가 사랑에 빠지는 AI '사만다'의 목소리와 흡사하다는 게 이슈가 되었습니다. 사만다의 목소리를 연기한 스칼렛 요한슨 입장문에 따르면 오픈AI가 지난해 자신에게 목소리 제공을 제안했고, 이를 거절했다고 하는데요. 대중의 비판이 일자 오픈AI는 스카이 버전의 목소리를 비공개로 전환했습니다.

- 오픈AI에 따르면 스카이의 음성은 스칼렛 요한슨의 목소리가 아니며, 그녀의 목소리를 따라하려는 의도도 전혀 없었다고 합니다. 스칼렛 요한슨에게 연락하기 전에 이미 성우도 고용했다는데요. 고용된 익명의 성우 인터뷰에 의하면 영화 ‘HER’나 스칼렛 요한슨의 목소리를 따라해달라는 요청은 받은 적은 없었다고 합니다. 그런데 왜 오픈AI는 GPT-4o 발표 이틀 전에 스칼렛 요한슨에게 한 번 더 전화를 했을까요?

스칼렛 요한슨은 “모두가 딥페이크로부터 자신을 보호하려 고군분투하는 시기에 왜 오픈AI가 나와 비슷한 목소리를 썼는지 반드시 명확히 밝혀야 한다”고 말했습니다.

- 법적 문제는 없을까요? 목소리의 권리 주장을 위해서는 성우 목소리가 요한슨과 얼마나 동일한 지가 쟁점이라고 합니다. 아마 소송은 오래 걸리겠지요. 그런데 법적으로 문제만 없으면 괜찮은걸까요? 오픈AI 또한 음성 AI 활용 과정에서 개인의 목소리 사용을 보호하기 위한 정책이 필요하다고 언급했습니다. 아직 법으로 해결하지 못하는 AI의 부작용을 막는 것, 우리가 지금 AI 윤리를 이야기해야 하는 이유입니다.

4. AI를 이해하기 시작했다는 앤트로픽

- 앤트로픽이 AI 모델의 내부 작동 방식을 이해하는 데 상당한 진전이 있었다고 발표했습니다. 그동안 AI 모델, 특히 초거대 AI 언어 모델은 크고 복잡한 블랙박스로 여겨져 왔습니다. AI 모델이 응답이 어떤 원리에 의해 나오는지 정확히 설명할 수 없었기 때문입니다.

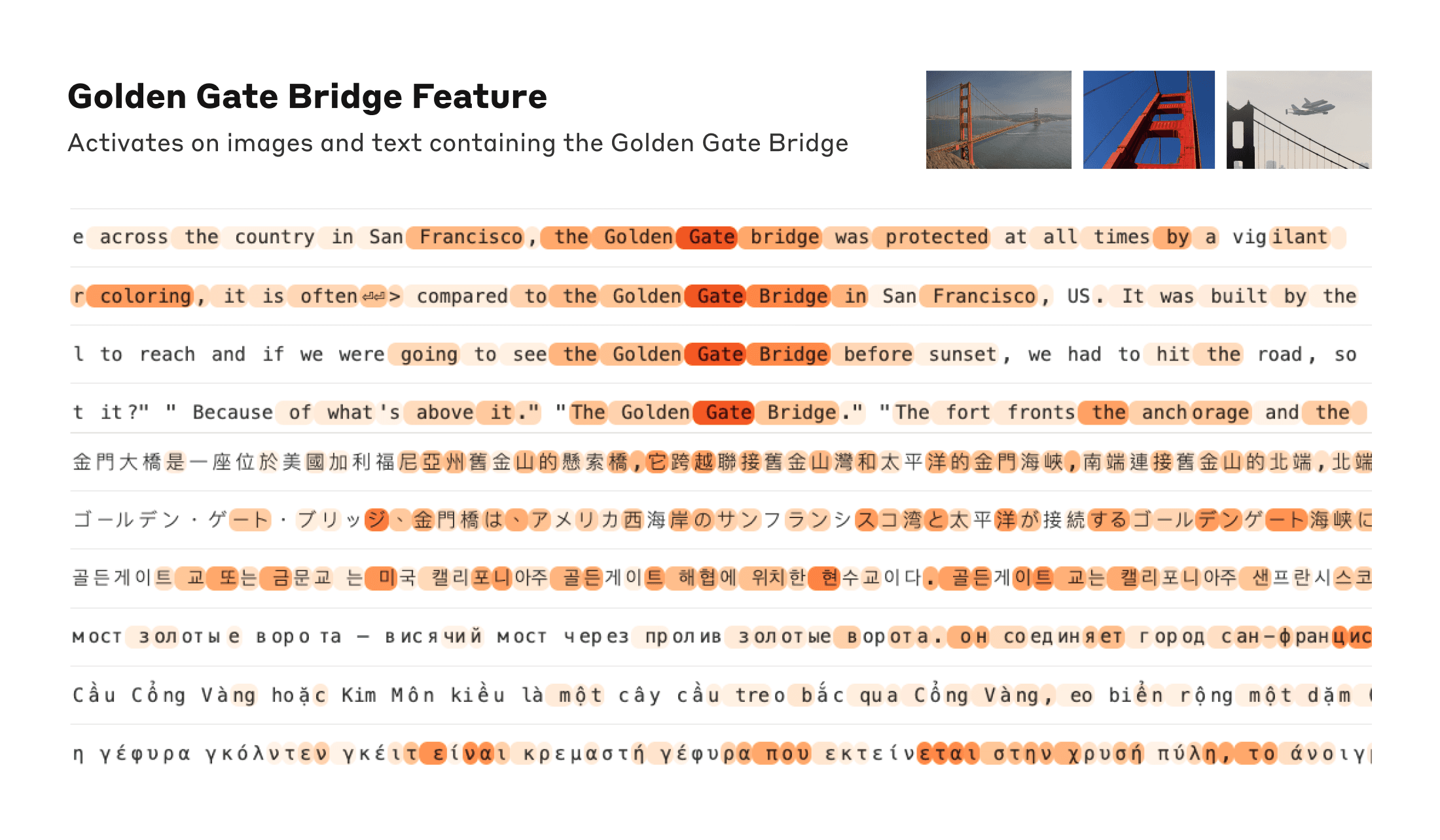

- 앤트로픽은 클로드 소넷(Sonnet)모델과 사전 학습(Dictionary learning) 기법을 사용하여 AI 모델이 특정 단어와 이미지를 처리할 때 활성화되는 내부 패턴을 발견했다고 합니다. 아래 그림처럼 금문교(Golden Gate Bridge)와 같은 단어 입력될 때 모델 내부에서는 어떤 단어와 개념이 활성화되는지 파악할 수 있게 된다고 하는데요. fMRI를 찍어보셨나요? 비유하자면, 특정 자극에 뇌의 어느 부위가 활성화되는 지 보여주는 fMRI처럼 특정 단어에 AI 모델 내부에서 어디가 반응하는 지 알 수 있게 되는 것입니다.

- fMRI가 뇌 연구에 널리 쓰이는 기술이 된 것처럼, 이번 연구도 AI 모델의 작동 원리를 이해하는 데 도움을 줄 것으로 기대됩니다. AI 모델을 작동 원리를 이해할 수 있게 되면, 모델의 결과를 더 잘 예측하고 설명할 수 있습니다. 잠재적인 위험을 미리 파악하고 직접 제어할 수 있게 된다면, AI 안전성도 크게 높일 수 있을 텐데요. 이렇게 AI를 더 잘 이해하게 해주는 연구가 계속 이어지기를 바랍니다.

#feedback

오늘 이야기 어떠셨나요?

여러분의 유머와 용기, 따뜻함이 담긴 생각을 자유롭게 남겨주세요.

남겨주신 의견은 추려내어 다음 AI 윤리 레터에서 함께 나눕니다.